Visión Artificial y Percepción Humana: Correspondencias y Divergencias

DOI:

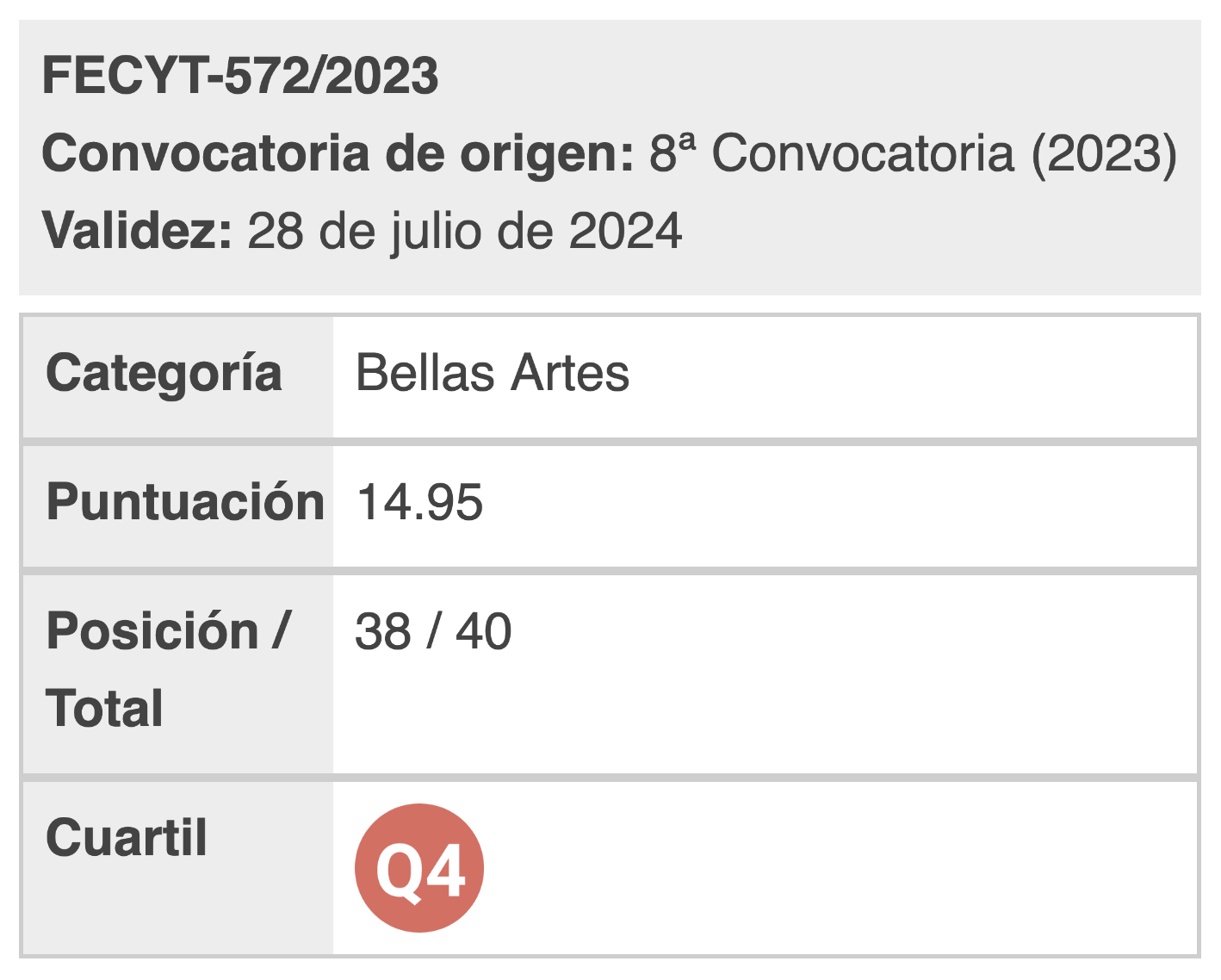

https://doi.org/10.33732/ASRI.6891Palabras clave:

IA, deep learning, CNN, neuromitología, abducciónResumen

Esta investigación parte de la correlación que se estableció entre la neurociencia y la computación con la llegada del conexionismo a las investigaciones en Inteligencia Artificial (IA), una relación que daría lugar al actual deep learning y, en particular, a las convolutional neural networks (CNN) para visión artificial. La hipótesis que plantea este artículo es que esta relación trajo consigo una neuromitología que sustenta el discurso mediático de la IA contemporánea, por el cual estamos cerca de alcanzar una superinteligencia computacional de carácter humano. Tomando como caso de estudio las CNN, se analizarán las relaciones y divergencias entre visión artificial y percepción humana, con el objetivo de desmitificar este discurso.Descargas

Citas

Aleksander, I. (2002). Neural Depictions of 'World' and 'Self': Bringing Computational Understanding to the Chinese Room. En Preston J. y Bishop M. (eds.), Views into the Chinese Room: new essays on Searle and artificial intelligence. (pp. 250-268). Oxford University Press.

Altman, Sam. 2024. "The Intelligence Age". Última modificación 23 de septiembre. https://ia.samaltman.com

Cuartas, J. (30 de enero de 2021). El concepto de la convolución en gráficos, para comprender las Convolutional Neural Networks (CNN) o redes convolucionadas. Medium. https://josecuartas.medium.com/el-concepto-de-la-convolución-en-gráficos-para-comprender-las-convolutional-neural-networks-cnn-519d2eee009c#:~:text=sensor%20radar

Crawford, K. (2021). Atlas of AI: Power, Politics, and the Planetary Costs of Artificial Intelligence. Yale University Press.

Faigenbaum, G. (2001). Conversaciones con John Searle. LibrosEnRed. Kindl e-book.

Gonçalo, L., Cunha, J. M., y Machado, P. (2021). Towards a Visual Language Using Neural Networks. En Proceedings of the Twelfth International Conference on Computational Creativity, ICCC 2021, México Virutal, septiembre 14-18, 419-423.

Ingold, T. (2001). From the Transmission of Representations to the Education of Attention. En Whitehouse, H. (ed.), The Debated Mind. Evolutionary Psychology Versus Ethnography. (pp. 113 – 153). Berg.

Kaput, M. (5 de marzo de 2024). Sam Altman Says AI Will Handle '95%' of Marketing Work Done by Agencies and Creatives. Marketing Artificial Intelligence Institute. https://www.marketingaiinstitute.com/blog/sam-altman-ai-agi-marketing.

Larson, E.J. (2022). El mito de la Inteligencia Artificial: por qué las máquinas no pueden pensar como nosotros lo hacemos. Shackleton Books, S.L.

Lindsay, G. (2022). Models of the Mind: How physics, engineering and mathematics have shaped our understanding of the brain. Bloomsbury.

Magnani, L. (2014). Understanding abduction. En Magnani, L. (ed.), Model-Based Reasoning in Science and Technology. Theoretical and Cognitive Issues. Studies in Applied Philosophy, Epistemology and Rational Ethics Vol. 8, 173-206. Springer-Verlag.

Musk, Elon [@elonmusk]. (7 de agosto 2023). I think we may have figured out some aspects of AGI. The car has a mind. Not an enormous mind, but a mind nonetheless. X (Twitter). https://x.com/elonmusk/status/1688476506295586816

Negrón, Juan José. 2020. "Inspiración Biológica de las Redes Neuronales Convolucionales". Medium. Última modificación 18 de septiembre. https://medium.com/soldai/inspiración-biológica-de-las-redes- neuronales-convolucionales-c686f74b4723

Olah, C., Mordvintsev, A., y Schubert, L. (7 de noviembre de 2017). Feature Visualization. How neural networks build up their understanding of images. Distill. https://distill.pub/2017/feature-visualization/

Pachón, A. (2024). Epistemic interfaces of visualization and interpretation: a possible resistance to the myth of autonomous agency in AI. Revista de Comunicação e Linguagens, 60, 91-113.

Pachón, A. (2025). The Mythical Speech of Artificial Intelligence: The Imaginary of an Autonomous Agency. En VandenBroek, A. K., Koycheva, L. y Artz, M (eds.), Anthopology of AI, 65-82. Routledge.

Pasquinelli, M. (2017). Machines that Morph Logic: Neural Networks and the Distorted Automation of Intelligence as Statistical Inference. Site 1: Logic Gate, the Politics of the Artifactual Mind. Glass Bead. https://www.glass-bead.org/article/machines-that-morph-logic/?lang=enview

Preston, J. (2002). Introduction. En Preston J. y Bishop M. (eds.), Views into the Chinese Room: new essays on Searle and artificial intelligence. (pp. 1-50). Oxford University Press.

Raftopoulos, A. (2001). Is perception informationally encapsulated? The issue of theory-ladenness of perception. Cognitive Sciencies, 25, 423–451.

Rajalingham, R., Issa E. B., Bashivan, P., Kar, K., Schmidt, K., y DiCarlo, J. J. (2018). Large-scale, high-resolution comparison of the core visual object recognition behavior of humans, monkeys, and state-of-the-art deep artificial neural networks. Journal of Neuroscience, 38, 7255–7269.

Reuters. (8 de abril de 2024). Tesla's Musk predicts AI will be smarter than the smartest human next year. Reuters. https://www.reuters.com/technology/teslas-musk-predicts-ai-will-be-smarter-than-smartest-human-next-year-2024-04-08/

Searle, J. R. (1984). Minds, Brains and Science. Harvard University Press.

Searle, J. R. (2002). Twenty-One Years in the Chinese Room. En Preston J. y Bishop M. (eds.), Views into the Chinese Room: new essays on Searle and artificial intelligence. (pp. 51-69). Oxford University Press.

Searle, J. R. (2018). Ver las cosas tal como son. Una teoría de la percepción. Oxford University Press.

Seisdedos, I. (16 de mayo de 2023). Sam Altman (ChatGPT), en el Capitolio: 'Si la inteligencia artificial sale mal, puede salir muy mal'. El País. https://elpais.com/tecnologia/2023-05-16/sam-altman-chatgpt-en-el-capitolio-si-la-inteligencia-artificial-sale-mal-puede-salir-muy-mal.html

Tallis, R. (2004). Why the Mind Is Not a Computer. A pocket Lexicon of Neuromythology. Imprint Academic.

Publicado

Cómo citar

Número

Sección

Licencia

Esta obra está bajo una licencia internacional Creative Commons Atribución 4.0.

Usted es libre de:

- Compartir — copiar y redistribuir el material en cualquier medio o formato

- Adaptar — remezclar, transformar y crear a partir del material

- para cualquier finalidad, incluso comercial.

- Reconocimiento — Debe reconocer adecuadamente la autoría, proporcionar un enlace a la licencia e indicar si se han realizado cambios<. Puede hacerlo de cualquier manera razonable, pero no de una manera que sugiera que tiene el apoyo del licenciador o lo recibe por el uso que hace.

- No hay restricciones adicionales — No puede aplicar términos legales o medidas tecnológicas que legalmente restrinjan realizar aquello que la licencia permite.